或许是疫情的余温,近两年的经济形势非常差,对我的工作也产生了深远的影响,去年 OpenAI 发布了 ChatGPT 🤖,我们公司不久也启动了若干 AI 相关的项目,我有幸(or not?…doesn’t matter)参与了其中一个,从那之后直到现在,漂泊的生活便没有停止过,我记忆中的 27 岁似乎比 26 岁更加漫长。

23 年上半年在一个不高不低的点买了房 🏠,原本计划着下半年买车 🚗,接着装修 🪜… 现在想想不知道还要等多久才能继续当时的规划。

去年 9 月份收到了通知,说我们有机会参加公司的某个 AI 相关的㊙️密项目,征求大家的参与意愿,想着能搭上 AI 这趟高速列车 🚄,我便决定参与到这个项目中,代价是未来几个月需要和来自各个工区的同事在杭州工区封闭开发项目。封闭的工作强度蛮高,但这种有目标的忙碌让人感到充实和安心。

至少在 2023 向我们挥手告别时,我们对未来是充满信心的,都期盼着更好的 2024。

🗓️ 壹月

去年项目封闭结束后我们便回到了武汉工区,因为项目还处于前期开发阶段,我们部门的员工又分部在全国各地,于是项目组提出了「旅游办公」的方案,也就是在上海、杭州、深圳各待几周集中开发。

一月份我们主要在深圳办公,不得感叹深圳的办公环境比其它工区好很多,深圳工区的办公大楼的视野非常好,和香港隔海相望,于是趁着这个机会和同事去香港体验了一下 City-Walk,顺便买了琦姐心心念念的相机。

|  |

|  |

🗓️ 贰月

二月最重要的事情就是过年啦 🧨,春节假期恰逢百年难得一遇的冻雨,难以忘记第一次开车回家 🚗 的体验。

🗓️ 叁月

去年租的房子到期了,选了很久选到了一个有停车位且环境非常不错的小区,离公司也很近,不得感叹生活越来越好啦!

三月底和琦姐的朋友们去武大看了樱花 🌸,当时正值晚樱,是最适合赏樱的时间,微风把樱花如细雨般吹落到地上,还是和第一次看见落樱时一样惊艳——希望明年也有机会回珈看樱花。

🗓️ 肆月

四月份公司高层对公司的布局做了很大的调整,撤销了我们部门的武汉分部,给大家发放 N+1 补偿,或者把工资提高 25% 然后转岗到上海(因为武汉的工资是一线城市的 0.8 倍)。

N+1 和转岗这两个选择让人感到迷茫,似乎又是一次人生道路上的转折点。

1️⃣ 如果选择转岗到上海,便需要在上海重新租房,并经常来回上海-武汉,提高的工资确实能 cover 这部分开销,不过可以想象到未来工作的疲惫程度。

2️⃣ 如果选择领取 N+1 补偿,便面临着和武汉同时失业同事们竞争本就不多的岗位,最后的工资福利和现有一定会存在较大落差,不利于长期发展。

和琦姐商量了两天,期间在两种方案中摇摆不定,最后决定转岗到上海,五月底开始在上海办公。

直到现在我也不知道这是否是一个正确的决定。

🗓️ 伍月

五一假期和琦姐自驾 🚗 到成都看汤尤杯比赛,非常幸运和运动员们住在同一个酒店,和喜欢的运动员一起吃早饭是一件很奇妙的事情。随着赛事圆满结束,我们也圆满地离开了成都。

|  |

|  |

上海和武汉有三个半小时的车程,每周往返的成本倒是不算高,也就习惯了这样的工作节奏,和同事在上海租了房子,正式开启沪漂之旅。

🗓️ 陆月

端午节和朋友们到洛阳玩,和当地羽协打了交流赛,到龙门石窟、古墓博物馆、白马寺、洛邑古镇打卡,不长的假期却过得非常充实。

六月份琦姐毕业了,工作地点在青山区,于是我们舍弃了这个刚租到的我们非常满意的小区,重新在青山租房。

也是这个月,我们忙碌了大半年的 AI 项目计划着正式对外上线,我需要负责其中一个上线前的改版需求,这期间一直在北京出差。在北京和同样从武汉来北京漂泊的朋友们吃了个饭,在知春路上聊着各自加入的新团队。

🗓️ 柒月

婆婆去世,请了几天丧假,再一次开车从武汉回家,开了十个小时。第二天一大早开车回老家,自高中毕业后就再也没有见过老家夏天的样子,漫山绿油油的玉米树让我很怀念小时候暑假回老家避暑的日子。

处理完家里的事情便回到工作中,后续一两周都在上海办公。

不巧的是,因为公司 AI 战略的调整,我们团队的工作重心改为支援一个海外项目,项目主要成员在深圳,所以后面我们需要长期在深圳出差了,真是世事难料。

海外项目差不多两周后,公司高层觉得当前业务的国内版本优先级比国外项目更高,于是我们又投入了一个月去支援国内项目,不过和负责人沟通后我们可以在武汉工区办公,这两周过得非常快乐。

🗓️ 捌月

八月份不出意外,又回到了海外项目继续之前未完成的工作。不得不说我非常喜欢在深圳出差时住的酒店,楼下有我喜欢的鲜榨甘蔗汁和福鼎肉片,每天下班回去买一份幸福感很高(不过每次都得祈祷一下城管不在)。

🗓️ 玖月

令人焦虑又兴奋的一个月,因为需要筹划去琦姐家见家长的事情,准备了很久礼物。

🗓️ 拾月

国庆节开车去琦姐家里,一路南下并没有堵车,和这趟路途一样,一切都很顺利。

令人难忘的国庆,每天都很充实,希望有时间能单独记录一下这段旅程。

|  |

|  |

离开吉安的时候阿姨送了一个车载玉坠,没有比这个更漂亮的挂饰了(在这之前我看过很多车载挂饰,都没有找到满意的,所以一直没有买)。

这个月剩下的时间仍然在深圳出差,深圳的天气真的很适合打工人。

🗓️ 拾壹月

公司出了新的出差政策,从武汉到深圳这种行程不能直接走公司平台预订,需要经过 Leader 审批后报销。所以为了省去一些麻烦,我们这个月便回到了上海办公。

期间还去了趟苏州,在阳澄湖吃了大闸蟹,也第一次尝试了钓鱼 🎣,不过啥也没钓到。

这个月海外项目第一版基本完成了,上层暂缓了第二版的计划,我也在这个间隙和 Leader 提了转岗申请,协商在下个月完成项目交接和转岗流程。

🗓️ 拾贰月

这个月主要的工作是给海外项目收尾,接着去深圳完成交接,然后加入上海的新团队。

今年的年终总决赛在杭州开打,我和琦姐分别从上海武汉出发,来杭州看了雅思最后一场国际比赛。这一次的酒店比起上次在成都的差了很多,但长期出差积攒了行政酒廊权益,不用为晚上吃啥顾虑了。

|  |

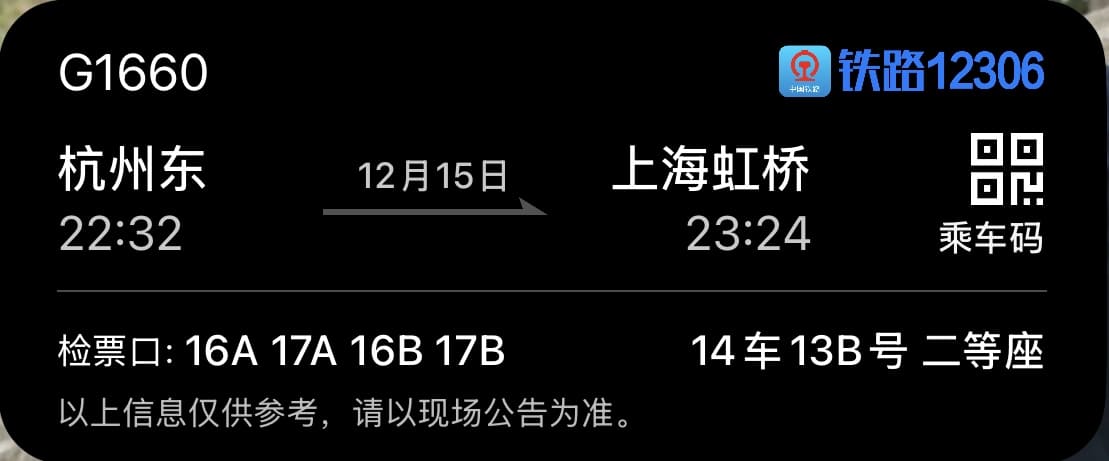

比赛看罢,送琦姐去杭州站,我也在最后十分钟赶上了杭州东站回上海的动车 🚄。

25 年元旦

去归元寺求了签,签运不错,希望新的一年越来越顺利,拜拜 2024 👋。

]]>